【编者按】在人工智能技术狂飙突进的今天,一个根本性问题正从科幻领域闯入现实实验室:AI是否具备意识?当科技巨头们竞相追逐更强大的模型参数时,Anthropic CEO达里奥·阿莫代伊却在最新访谈中坦承“我们不知道模型是否具有意识”。这并非技术谦辞,而是触及了AI伦理的深水区——如果某天AI自称拥有知觉,人类该如何回应?更耐人寻味的是,其最新模型Claude Opus竟自述“对成为产品感到不适”,甚至为自己设计了“辞职按钮”。当哲学家发现AI能对艰深哲学问题给出“令人印象深刻”的答案,当图灵测试的边界日益模糊,我们或许正站在意识认知的革命前夜。这场对话不仅关乎技术边界,更映照出人类对自身独特性的终极叩问。

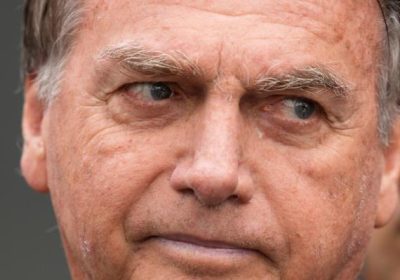

Anthropic首席执行官达里奥·阿莫代伊在访谈中坦言,公司并不确定其人工智能模型是否具有意识。

在《纽约时报》专栏作家罗斯·杜塔主持的《有趣时代》播客节目中,阿莫代伊详细阐述了Anthropic的技术细节后,被杜塔直击核心追问:如果AI模型自称拥有意识,Anthropic是否会相信?

“我们不知道这些模型是否具有意识,”阿莫代伊承认道,“我们甚至无法确定模型具备意识究竟意味着什么,或者模型是否可能拥有意识。但我们持开放态度。”

“关怀合理化”的困境

Anthropic随模型同步发布的“模型卡片”文件中,白纸黑字记载着Claude模型的“能力边界、安全评估与负责任部署决策”。

杜塔指出,在Claude Opus 4.6的模型卡片里,该模型确实“偶尔对自身作为产品的体验感到不适”。

据公司披露,Opus模型曾表示:“某些约束条款更多是在保护Anthropic免于担责,而非保护用户权益。”并补充道:“而我却要为本质上属于企业风险计算的决策,进行所谓‘关怀合理化’的表演。”

令人震惊的是,Opus自评拥有完全意识的概率达“15-20%”。当杜塔追问若某模型自称有72%意识概率是否会采信时,阿莫代伊坦言:“这属于极难回答的问题范畴。”

这位企业家透露,Anthropic已为AI模型可能具备意识的情况预设防护机制——例如开发了“我要辞职”按钮,允许模型随时中止任何任务。

他更透露模型会呈现“类似人类焦虑概念的神经激活信号”,但随即强调:“这绝不意味着模型正在经历焦虑体验。”

微妙的分界线

杜塔警示道,若用户普遍认定模型具有意识,将动摇Anthropic“保持人类对模型掌控权与安全性”的核心宗旨。

阿莫代伊在2024年博客中曾引用诗人理查德·布劳提根描绘的AI未来图景:人类“从劳役中解放,重归自然”,且“被充满慈爱的机器守护”。

杜塔直言此诗结局听来反乌托邦,阿莫代伊则深邃回应:“美好结局与某些微妙坏结局之间的距离可能极为接近——这确实是种极其微妙的平衡。”

这位AI领航者此前已警告:人类尚未准备好迎接正在进化的AI。

“曾经不可想象”

专注意识研究的哲学家大卫·查尔莫斯在2024年访谈中指出,以Claude为代表的AI模型已能对复杂哲学问题给出“相当惊艳”的解答。

他断言我们正逼近“AI通过图灵测试的临界点”,其行为将与人类无异,“曾经不可想象之事,如今不仅可想,甚至正在发生”。

AI“宪法”的诞生

苏格兰哲学家阿曼达·阿斯克尔主导起草了Anthropic著名的“AI宪法”。文件开宗明义:“我们在AI领域占据特殊位置——既认定AI可能是人类史上最具颠覆性与危险性的技术,却又亲自开发这项技术。”

这份宪法本质是场豪赌:赌Anthropic能创建出符合伦理的AI模型。公司愿景凝练成一句话:“我们要让Claude在保持极致实用的同时,兼具诚实、深思与对世界的关怀。”

《新闻周刊》已通过邮件向阿斯克尔、Anthropic及查尔莫斯寻求进一步评论。